Elementos básicos de la capacitación en redes neuronales artificiales Ppt

Estas diapositivas analizan el concepto de redes neuronales artificiales. Hay tres capas en la red neuronal, la capa de entrada, la capa oculta y la capa de salida. La función de activación se usa para calcular un total ponderado y luego agregarle un sesgo para determinar si una neurona debe activarse o no. También describe el funcionamiento de una red neuronal. También explica el descenso de gradiente y la retropropagación.

You must be logged in to download this presentation.

Impress your

Impress your audience

Editable

of Time

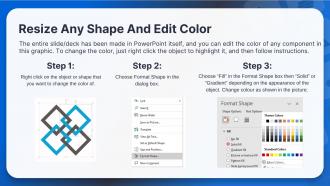

Características de estas diapositivas de presentación de PowerPoint:

People who downloaded this PowerPoint presentation also viewed the following :

Contenido de esta presentación de Powerpoint

Diapositiva 1

Esta diapositiva muestra una diapositiva de separación para la introducción de la sesión a los fundamentos de las ventas.

Diapositiva 2

Esta diapositiva muestra las capas en una red neuronal. Hay tres capas conocidas como capa de entrada, capa oculta y capa de salida.

Notas del instructor:

- Capa de entrada: la capa de entrada es lo primero. Esta capa aceptará los datos, que luego los enviarán al resto de la red.

- Capa oculta: La capa oculta es la segunda de las tres capas. Las capas ocultas de una red neuronal pueden ser una o más. Las capas ocultas son las responsables del alto rendimiento y la complejidad de las redes neuronales. Pueden realizar una serie de tareas a la vez, como la transformación de datos, el desarrollo automático de funciones, etc.

- Capa de salida: La capa de salida es la capa final. El resultado o salida del problema se almacena en la capa de salida. La capa de entrada recibe fotos en bruto y la capa de salida entrega la versión final del resultado.

Diapositiva 3

Esta diapositiva ilustra las neuronas artificiales presentes en las capas de una red neuronal artificial (ANN). Hace una comparación entre las neuronas biológicas presentes en los cerebros humanos con una neurona artificial en una RNA.

Notas del instructor: una capa está formada por unidades microscópicas conocidas como neuronas. Una neurona en una red neuronal se puede entender mejor con la ayuda de neuronas biológicas. Una neurona artificial es análoga a una neurona biológica. Toma información de otras neuronas, la procesa y luego produce una salida. Aquí, X1 y X2 son las entradas de las neuronas artificiales, f(X) es el procesamiento realizado en las entradas e y es la salida de la neurona.

Diapositiva 4

Esta diapositiva ofrece una introducción a la función de activación en una red neuronal y analiza su importancia. La función de activación se usa para calcular un total ponderado y luego agregarle un sesgo para determinar si una neurona debe activarse o no.

Diapositiva 5

Esta diapositiva ilustra la función de umbral, que es un tipo de función de activación en una red neuronal. Esta función tiene solo dos salidas posibles: 0 o 1. Generalmente se emplean cuando solo se deben clasificar dos tipos de datos.

Diapositiva 6

Esta diapositiva muestra la función sigmoidea, que es un tipo de función de activación. El rango de valores para la función sigmoidea es de 0 a 1. Esta función se emplea principalmente en la capa de salida porque es desde este nodo que obtenemos el valor anticipado

Diapositiva 7

Esta diapositiva ilustra la función Rectificador o ReLU, que es un tipo de función de activación. Relu (Unidades lineales rectificadas) se emplea principalmente en capas ocultas de una red neuronal debido a su naturaleza rectificada. Relu es una función semirrectificada que comienza en la parte inferior. Se mueve continuamente hasta cierto punto y luego aumenta a su máximo después de un cierto período

Diapositiva 8

Esta diapositiva muestra la función de tangente hiperbólica, que es un tipo de función de activación. La función Tanh es una versión mejorada de la función sigmoidea que incluye un rango de valores de -1 a 1. Tanh tiene una forma de curva sigmoidea, aunque con un rango distinto de valores. El beneficio es que, dependiendo de sus proyecciones, tanto los resultados negativos como los positivos se trazan por separado.

Diapositiva 9

Esta diapositiva describe el funcionamiento de una red neuronal artificial. Las redes neuronales artificiales pueden considerarse gráficos dirigidos ponderados en los que las neuronas se comparan con nodos y las conexiones entre neuronas se comparan con bordes ponderados.

Notas del instructor: el elemento de procesamiento de una neurona recibe muchas señales, que ocasionalmente se alteran en la sinapsis receptora antes de sumarse en el elemento de procesamiento. Si alcanza el umbral, se convierte en una entrada para otras neuronas y el ciclo comienza de nuevo.

Diapositiva 10

Esta diapositiva presenta el concepto de descenso de gradiente. Gradient Descent es un proceso de optimización que se utiliza en los algoritmos de aprendizaje automático para minimizar la función de costo (el error entre la salida real y la prevista). Se utiliza principalmente para actualizar los parámetros del modelo de aprendizaje.

Diapositiva 11

Esta diapositiva enumera los tipos de descenso de gradiente. Estos incluyen el descenso de gradiente por lotes, el descenso de gradiente estocástico y el descenso de gradiente de mini lotes.

Notas del instructor:

- Descenso de gradiente por lotes: el descenso de gradiente por lotes agrega los errores para cada punto en un conjunto de entrenamiento antes de actualizar el modelo después de que se hayan revisado todas las instancias de entrenamiento. Este proceso se conoce como la Época de Entrenamiento. El descenso de gradiente por lotes generalmente proporciona un gradiente de error constante y una convergencia, aunque elegir el mínimo local en lugar del mínimo global no siempre es la mejor solución.

- Descenso de gradiente estocástico: el descenso de gradiente estocástico crea una época de entrenamiento para cada ejemplo en el conjunto de datos y cambia los parámetros de cada ejemplo de entrenamiento, secuencialmente. Estas actualizaciones frecuentes pueden proporcionar mayor detalle y velocidad, pero también pueden producir gradientes ruidosos, que pueden ayudar a superar el mínimo local y ubicar el global.

- Descenso de gradiente de mini lotes: el descenso de gradiente de mini lotes combina los principios del descenso de gradiente de lotes con el descenso de gradiente estocástico. Divide el conjunto de datos de entrenamiento en distintos grupos y los actualiza por separado. Este método equilibra la eficiencia informática del descenso de gradiente por lotes y la velocidad del descenso de gradiente estocástico

Diapositiva 12

Esta diapositiva describe el concepto de retropropagación junto con sus dos tipos, que son la retropropagación estática y la retropropagación recurrente. La retropropagación es útil para calcular el gradiente de una función de pérdida con respecto a todos los pesos de la red.

Notas del instructor:

- Propagación inversa estática: la asignación de entrada estática genera una salida estática en este tipo de propagación inversa. Se utiliza para abordar desafíos como el reconocimiento óptico de caracteres que requiere una clasificación estática.

- Propagación inversa recurrente: la propagación recurrente se dirige hacia adelante o se lleva a cabo hasta que se alcanza un valor establecido específico o un valor de umbral. El error se evalúa y se propaga hacia atrás después de alcanzar un valor particular

Diapositiva 13

Esta diapositiva enumera las ventajas de Backpropagation. Estos son que es simple y directo, adaptable y eficiente, y no requiere características únicas.

Diapositiva 14

Esta diapositiva enumera las desventajas de Backpropagation. Estos son que la entrada de datos determina la función de toda la red en un tema particular, las redes son susceptibles a datos ruidosos y se utiliza una técnica basada en matriz.

Diapositiva 15

Esta diapositiva enumera las ventajas de las redes neuronales artificiales. Estas ventajas incluyen que ANN almacena información en toda la red, su capacidad para trabajar con conocimientos insuficientes, su tolerancia a fallas, una memoria distribuida y capacidad de procesamiento en paralelo.

Notas del instructor:

- Almacenamiento de información en toda la red: La información se guarda en toda la red, no en una base de datos, como se hace en la programación tradicional. La red continúa funcionando a pesar de perder algunos datos en una ubicación

- Capacidad para trabajar con conocimientos insuficientes: después de entrenar la red neuronal artificial, los datos pueden generar resultados incluso con información limitada o insuficiente

- Tolerancia a fallas: la salida de una ANN no se ve afectada por la corrupción de una o más de sus celdas. Las redes se vuelven tolerantes a fallas como resultado de esta característica.

- Memoria distribuida: se requiere para determinar los ejemplos y entrenar la red de acuerdo con la salida prevista. El progreso de la red es proporcional a las instancias elegidas. Si el evento no se puede mostrar en la red en todos los aspectos, puede generar resultados inexactos

- Capacidad de procesamiento paralelo: las redes neuronales artificiales tienen el poder computacional para realizar múltiples tareas a la vez

- Corrupción gradual: la red no se corroe de inmediato, ya que su rendimiento se degrada y se ralentiza con el tiempo.

Diapositiva 16

Esta diapositiva enumera las desventajas de las redes neuronales artificiales. Estas desventajas incluyen la dependencia del hardware de las ANN, el funcionamiento inexplicable de la red, la dificultad de mostrar el problema a la red y la falta de claridad sobre la estructura de red adecuada que funciona.

Notas del instructor:

- Dependencia del hardware: la estructura de las redes neuronales artificiales requiere un poder de procesamiento paralelo. Como resultado, la implementación depende del equipo.

- Funcionamiento inexplicable de la red: cuando ANN proporciona una solución de sondeo, no explica por qué o cómo se eligió. Esto disminuye la confianza en la red.

- Dificultad de mostrar el problema a la red: las ANN pueden trabajar con datos numéricos. Antes de introducir ANN a un problema, debe transformarse en valores numéricos. El mecanismo de visualización elegido aquí tendrá un impacto directo en el rendimiento de la red, según el nivel de habilidad del usuario.

- No hay claridad sobre la estructura de red adecuada que funciona: ninguna regla explícita determina la estructura de las redes neuronales artificiales. La experiencia y el ensayo y error se utilizan para crear la estructura de red ideal

Fundamentos de entrenamiento de redes neuronales artificiales Ppt con las 32 diapositivas:

Utilice nuestro Ppt de capacitación sobre los fundamentos de las redes neuronales artificiales para ayudarlo de manera efectiva a ahorrar su valioso tiempo. Están listos para encajar en cualquier estructura de presentación.

-

I was able to find the right choice of PPT template for my thesis with SlideTeam. Thank you for existing.

-

The website is jam-packed with fantastic and creative templates for a variety of business concepts. They are easy to use and customize.