Fundamentos do treinamento em redes neurais artificiais Ppt

Estes slides discutem o conceito de redes neurais artificiais. Existem três camadas na rede neural: a camada de entrada, a camada oculta e a camada de saída. A função de ativação é usada para calcular um total ponderado e, em seguida, adicionar viés a ele para determinar se um neurônio deve ser ativado ou não. Ele também descreve o funcionamento de uma rede neural. Também explica a descida do gradiente e a retropropagação.

You must be logged in to download this presentation.

Impress your

Impress your audience

Editable

of Time

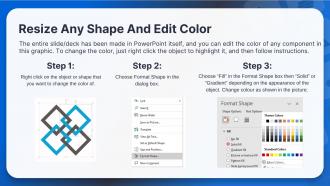

Recursos desses slides de apresentação do PowerPoint:

People who downloaded this PowerPoint presentation also viewed the following :

Conteúdo desta apresentação em Powerpoint

Slide 1

Este slide mostra um slide separador para a sessão de introdução aos fundamentos de vendas.

Slide 2

Este slide descreve as camadas em uma rede neural. Existem três camadas conhecidas como camada de entrada, camada oculta e camada de saída.

Notas do instrutor:

- Camada de entrada: A camada de entrada vem primeiro. Essa camada aceitará os dados, que os enviarão para o restante da rede

- Camada Oculta: A camada oculta é a segunda das três camadas. As camadas ocultas de uma rede neural podem ser uma ou mais em número. As camadas ocultas são as responsáveis pelo alto desempenho e complexidade das redes neurais. Eles podem executar várias tarefas ao mesmo tempo, como transformação de dados, desenvolvimento automático de recursos, etc.

- Camada de Saída: A camada de saída é a camada final. O resultado ou saída do problema é armazenado na camada de saída. A camada de entrada recebe fotos brutas e a camada de saída entrega a versão final do resultado

Slide 3

Este slide ilustra os neurônios artificiais presentes nas camadas de uma Rede Neural Artificial (ANN). Ele traça uma comparação entre os neurônios biológicos presentes no cérebro humano com um neurônio artificial em uma RNA.

Notas do instrutor: Uma camada é composta de unidades microscópicas conhecidas como neurônios. Um neurônio em uma rede neural pode ser melhor compreendido com a ajuda de neurônios biológicos. Um neurônio artificial é análogo a um neurônio biológico. Ele recebe informações de outros neurônios, processa-as e, em seguida, produz uma saída. Aqui, X1 e X2 são as entradas dos neurônios artificiais, f(X) é o processamento feito nas entradas e y é a saída do neurônio.

Slide 4

Este slide apresenta uma introdução à função de ativação em uma rede neural e discute sua importância. A função de ativação é usada para calcular um total ponderado e, em seguida, adicionar viés a ele para determinar se um neurônio deve ser ativado ou não.

Slide 5

Este slide ilustra a Função Limiar, que é um tipo de Função de Ativação em uma rede neural. Esta função tem apenas duas saídas possíveis: 0 ou 1. Elas são geralmente empregadas quando apenas dois tipos de dados devem ser classificados.

Slide 6

Este slide descreve a Função Sigmóide, que é um tipo de função de ativação. O intervalo de valores para a função sigmoide é de 0 a 1. Essa função é empregada principalmente na camada de saída porque é desse nó que obtemos o valor antecipado

Slide 7

Este slide ilustra a função Retificador ou ReLU, que é um tipo de função de ativação. Relu (Rectified Linear Units) é empregado principalmente em camadas ocultas de uma Rede Neural devido à sua natureza retificada. Relu é uma função semi-retificada começando na parte inferior. Ele se move continuamente até um certo ponto e depois aumenta até seu máximo após um certo período

Slide 8

Este slide descreve a Função Tangente Hiperbólica, que é um tipo de função de ativação. A função Tanh é uma versão atualizada da função sigmóide que inclui um intervalo de valores de -1 a 1. Tanh tem uma forma de curva sigmóide, embora com um intervalo distinto de valores. O benefício é que, dependendo de suas projeções, resultados negativos e positivos são plotados separadamente

Slide 9

Este slide descreve o funcionamento de uma Rede Neural Artificial. As Redes Neurais Artificiais podem ser consideradas grafos direcionados ponderados nos quais os neurônios são comparados aos nós, e as conexões entre os neurônios são comparadas às arestas ponderadas.

Notas do instrutor: O elemento de processamento de um neurônio recebe muitos sinais, que são ocasionalmente alterados na sinapse receptora antes de serem somados no elemento de processamento. Se atingir o limite, torna-se uma entrada para outros neurônios e o ciclo começa novamente

Slide 10

Este slide apresenta o conceito de gradiente descendente. Gradient Descent é um processo de otimização usado em algoritmos de aprendizado de máquina para minimizar a função de custo (o erro entre a saída real e a prevista). É usado principalmente para atualizar os parâmetros do modelo de aprendizagem.

Slide 11

Este slide lista os tipos de gradiente descendente. Isso inclui descida de gradiente em lote, descida de gradiente estocástico e descida de gradiente em minilote.

Notas do instrutor:

- Descida de Gradiente em Lote: A descida de gradiente em lote adiciona os erros para cada ponto em um conjunto de treinamento antes de atualizar o modelo após a revisão de todas as instâncias de treinamento. Este processo é conhecido como a Época de Treinamento. A descida do gradiente em lote geralmente fornece um gradiente de erro constante e convergência, embora escolher o mínimo local em vez do mínimo global nem sempre seja a melhor solução

- Descida de Gradiente Estocástico: A descida de gradiente estocástico cria uma época de treinamento para cada exemplo no conjunto de dados e altera os parâmetros de cada exemplo de treinamento, sequencialmente. Essas atualizações frequentes podem fornecer mais detalhes e velocidade, mas também podem produzir gradientes ruidosos, que podem ajudar a ultrapassar o mínimo local e localizar o global

- Descida de gradiente em minilote: A descida de gradiente em minilote combina os princípios da descida de gradiente em lote com a descida de gradiente estocástico. Ele divide o conjunto de dados de treinamento em grupos distintos e os atualiza separadamente. Este método equilibra a eficiência de computação da descida do gradiente em lote e a velocidade da descida do gradiente estocástico

Slide 12

Este slide descreve o conceito de retropropagação junto com seus dois tipos que são retropropagação estática e retropropagação recorrente. A retropropagação é útil para calcular o gradiente de uma função de perda em relação a todos os pesos da rede.

Notas do instrutor:

- Retropropagação Estática: O mapeamento da entrada estática gera uma saída estática neste tipo de retropropagação. Ele é usado para enfrentar desafios como reconhecimento óptico de caracteres que requer classificação estática

- Retropropagação Recorrente: A Propagação Recorrente é direcionada para frente ou conduzida até que um valor definido específico ou valor limite seja atingido. O erro é avaliado e propagado para trás depois de atingir um valor específico

Slide 13

Este slide lista as vantagens do Backpropagation. Estes são que é simples e direto, adaptável e eficiente e não requer nenhuma característica única.

Slide 14

Este slide lista as desvantagens do Backpropagation. Estes são que a entrada de dados determina a função de toda a rede em um determinado problema, as redes são suscetíveis a dados ruidosos e uma técnica baseada em matriz é usada.

Slide 15

Este slide lista as vantagens das Redes Neurais Artificiais. Essas vantagens incluem que a ANN armazena informações em toda a rede, sua capacidade de trabalhar com conhecimento insuficiente, sua tolerância a falhas, memória distribuída e capacidade de processamento paralelo.

Notas do instrutor:

- Armazenamento de informações em toda a rede: As informações são salvas em toda a rede, não em um banco de dados, como é feito na programação tradicional. A rede continua a funcionar apesar de perder algumas informações em um local

- Capacidade de trabalhar com conhecimento insuficiente: Após o treinamento da Rede Neural Artificial, os dados podem produzir resultados mesmo com informações limitadas ou insuficientes

- Tolerância a falhas: A saída de uma RNA não é afetada pela corrupção de uma ou mais de suas células. As redes tornam-se tolerantes a falhas como resultado dessa característica

- Memória distribuída: É necessária para determinar os exemplos e treinar a rede de acordo com a saída pretendida. O progresso da rede é proporcional às instâncias escolhidas. Se o evento não puder ser exibido para a rede em todos os aspectos, pode gerar resultados imprecisos

- Capacidade de processamento paralelo: as redes neurais artificiais têm o poder computacional para executar várias tarefas ao mesmo tempo

- Corrupção gradual: a rede não é corroída imediatamente, pois seu desempenho diminui e diminui com o tempo.

Slide 16

Este slide lista as desvantagens das Redes Neurais Artificiais. Essas desvantagens incluem dependência de hardware das RNAs, funcionamento inexplicável da rede, dificuldade de mostrar problemas para a rede e falta de clareza sobre a estrutura de rede adequada que funciona.

Notas do instrutor:

- Dependência de hardware: A estrutura das Redes Neurais Artificiais necessita de poder de processamento paralelo. Como resultado, a implementação depende do equipamento

- Funcionamento inexplicável da rede: Quando a ANN fornece uma solução de sondagem, ela não explica por que ou como ela foi escolhida. Isso diminui a confiança na rede

- Dificuldade de mostrar problema para a rede: RNAs são capazes de trabalhar com dados numéricos. Antes de introduzir a RNA em um problema, ela deve ser transformada em valores numéricos. O mecanismo de exibição escolhido aqui impactará diretamente no desempenho da rede, dependendo do nível de habilidade do usuário

- Nenhuma clareza sobre a estrutura de rede adequada que funciona: nenhuma regra explícita determina a estrutura das redes neurais artificiais. Experiência e tentativa e erro são usados para criar a estrutura de rede ideal

Ppt de treinamento de fundamentos de redes neurais artificiais com todos os 32 slides:

Use nosso Ppt de Treinamento de Fundamentos de Redes Neurais Artificiais para ajudá-lo efetivamente a economizar seu valioso tempo. Eles estão prontos para caber em qualquer estrutura de apresentação.

-

I was able to find the right choice of PPT template for my thesis with SlideTeam. Thank you for existing.

-

The website is jam-packed with fantastic and creative templates for a variety of business concepts. They are easy to use and customize.