Variantes de arquitecturas de redes neuronales recurrentes Ppt de capacitación

Este conjunto de diapositivas PPT proporciona información sobre las variantes de arquitecturas de redes neuronales recurrentes. Estos incluyen redes neuronales recurrentes bidireccionales, memoria a largo plazo y unidades recurrentes cerradas.

You must be logged in to download this presentation.

Impress your

Impress your audience

Editable

of Time

Características de estas diapositivas de presentación de PowerPoint:

People who downloaded this PowerPoint presentation also viewed the following :

Contenido de esta presentación de Powerpoint

Diapositiva 1

Esta diapositiva muestra tres variantes de arquitecturas de redes neuronales recurrentes. Estos incluyen redes neuronales recurrentes bidireccionales, memoria a largo plazo y unidades recurrentes cerradas.

Diapositiva 2

Esta diapositiva habla sobre la red neuronal recurrente bidireccional como arquitectura. Los RNN bidireccionales extraen datos futuros para aumentar la precisión, mientras que los RNN unidireccionales solo pueden basarse en entradas anteriores para crear predicciones sobre el estado actual.

Diapositiva 3

Esta diapositiva proporciona información sobre la memoria a largo plazo como arquitectura. LSTM es un diseño RNN bien conocido desarrollado por Sepp Hochreiter y Juergen Schmidhuber para abordar el problema del gradiente de fuga.

Notas del instructor: en las capas profundas de la red neuronal, los LSTM tienen "celdas" que tienen tres puertas: puerta de entrada, puerta de salida y puerta de olvido. Estas puertas regulan el flujo de datos necesarios para pronosticar la salida de la red.

Diapositiva 4

Esta diapositiva habla de las unidades recurrentes cerradas como arquitectura. Esta versión de RNN es similar a los LSTM porque también funciona para resolver el problema de memoria a corto plazo de los modelos RNN. Emplea estados ocultos en lugar de "estados de celda" para gobernar la información, y en lugar de tres puertas, solo tiene dos: una puerta de reinicio y una puerta de actualización.

Variantes de arquitecturas de redes neuronales recurrentes Ppt de entrenamiento con las 20 diapositivas:

Utilice nuestro Ppt de capacitación sobre variantes de arquitecturas de redes neuronales recurrentes para ayudarlo de manera efectiva a ahorrar su valioso tiempo. Están listos para encajar en cualquier estructura de presentación.

-

SlideTeam, Please don’t stop sharing discount coupons! I love your occasional discounts and tend to buy your products around that corner.

-

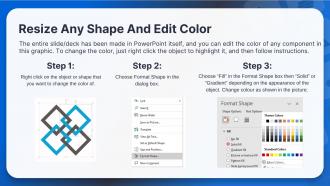

Extremely professional slides with attractive designs. I especially appreciate how easily they can be modified and come in different colors, shapes, and sizes!